Espaces préhilbertiens#

La notion de produit scalaire est à la géométrie ce que la notion de mesure est à l’analyse : elle permet de quantifier.

John von Neumann

Introduction#

Le chapitre précédent a développé la théorie générale des formes bilinéaires. Nous nous concentrons ici sur le cas le plus riche : les formes bilinéaires symétriques définies positives, c’est-à-dire les produits scalaires. Ce cadre fournit les notions de norme, d’angle, de projection orthogonale, d’adjoint, et culmine avec le théorème spectral : toute matrice symétrique réelle est diagonalisable en base orthonormale.

Produit scalaire#

Définition 192 (Produit scalaire réel)

Soit \(E\) un \(\mathbb{R}\)-espace vectoriel. Un produit scalaire sur \(E\) est une forme bilinéaire symétrique définie positive :

bilinéaire symétrique : \(\langle x, y\rangle = \langle y, x\rangle\) et linéaire en chaque variable

définie positive : \(\langle x, x\rangle \geq 0\) et \(\langle x, x\rangle = 0 \Rightarrow x = 0\)

Un espace préhilbertien réel est un tel couple \((E, \langle\cdot,\cdot\rangle)\). Un espace euclidien est un espace préhilbertien réel de dimension finie.

Définition 193 (Produit scalaire hermitien)

Soit \(E\) un \(\mathbb{C}\)-espace vectoriel. Un produit scalaire hermitien est \(\langle\cdot,\cdot\rangle : E \times E \to \mathbb{C}\) vérifiant :

semi-linéarité à gauche : \(\langle \lambda x, y\rangle = \bar\lambda \langle x, y\rangle\)

linéarité à droite : \(\langle x, \lambda y\rangle = \lambda \langle x, y\rangle\)

hermitianité : \(\langle x, y\rangle = \overline{\langle y, x\rangle}\)

définie positive : \(\langle x, x\rangle > 0\) pour \(x \neq 0\)

Un espace hermitien est un \(\mathbb{C}\)-espace vectoriel de dimension finie muni d’un tel produit.

Exemple 98

Canonique sur \(\mathbb{R}^n\) : \(\langle x, y\rangle = \sum x_i y_i = x^T y\)

Canonique sur \(\mathbb{C}^n\) : \(\langle x, y\rangle = \sum \bar x_i y_i = x^* y\)

\(L^2\) sur \(\mathcal{C}([a,b])\) : \(\langle f, g\rangle = \int_a^b f(t)g(t)\,dt\)

Frobenius sur \(\mathcal{M}_n(\mathbb{R})\) : \(\langle A, B\rangle = \operatorname{tr}(A^T B)\)

Polynômes : \(\langle P, Q\rangle = \int_{-1}^1 P(t)Q(t)\,dt\) (produit de Legendre)

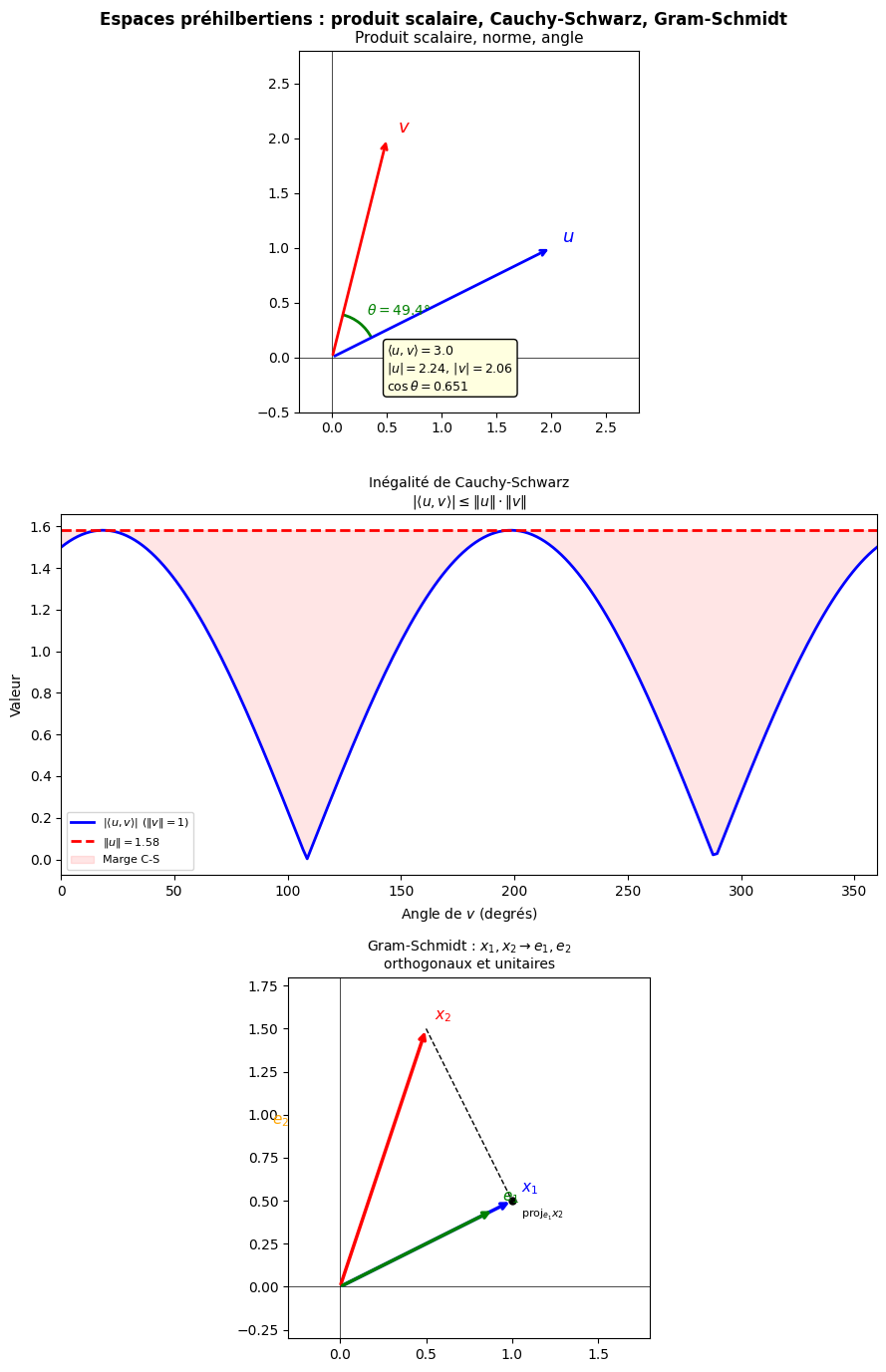

Norme et inégalité de Cauchy-Schwarz#

Définition 194 (Norme euclidienne)

La norme associée au produit scalaire est \(\|x\| = \sqrt{\langle x, x\rangle}\). La distance est \(d(x, y) = \|x - y\|\).

Théorème 3 (Inégalité de Cauchy-Schwarz)

\(\forall x, y \in E\),

avec égalité si et seulement si \(x\) et \(y\) sont colinéaires.

Proof. Si \(y = 0\), les deux membres sont nuls. Supposons \(y \neq 0\). Pour tout \(t \in \mathbb{R}\),

Ce trinôme (en \(t\)) est \(\geq 0\) donc son discriminant est \(\leq 0\) : \(4\langle x, y\rangle^2 - 4\|x\|^2\|y\|^2 \leq 0\).

Égalité : \(f\) s’annule en \(t_0 = -\langle x,y\rangle/\|y\|^2\), i.e. \(x = -t_0 y\).

Proposition 278 (Propriétés de la norme)

\(\|\cdot\|\) est une norme : \(\|x\| \geq 0\), \(\|x\| = 0 \Leftrightarrow x = 0\), \(\|\lambda x\| = |\lambda|\|x\|\), \(\|x+y\| \leq \|x\|+\|y\|\).

Proof. Inégalité triangulaire : \(\|x+y\|^2 = \|x\|^2 + 2\langle x,y\rangle + \|y\|^2 \leq \|x\|^2 + 2\|x\|\|y\| + \|y\|^2 = (\|x\|+\|y\|)^2\).

Proposition 279 (Identités fondamentales)

Parallélogramme : \(\|x+y\|^2 + \|x-y\|^2 = 2(\|x\|^2 + \|y\|^2)\)

Polarisation : \(\langle x, y\rangle = \frac{1}{4}(\|x+y\|^2 - \|x-y\|^2)\)

Ces identités caractérisent les normes provenant d’un produit scalaire.

Proof. \(\|x \pm y\|^2 = \|x\|^2 \pm 2\langle x,y\rangle + \|y\|^2\). En additionnant ou soustrayant.

Orthogonalité#

Définition 195 (Orthogonalité)

\(x \perp y\) si \(\langle x, y\rangle = 0\). Une famille est orthogonale si \(\langle e_i, e_j\rangle = 0\) pour \(i \neq j\), orthonormale (ONF) si de plus \(\|e_i\| = 1\).

Théorème 4 (Pythagore généralisé)

Si \((x_1, \ldots, x_k)\) est orthogonale : \(\left\|\sum_{i=1}^k x_i\right\|^2 = \sum_{i=1}^k \|x_i\|^2\).

Proposition 280 (ONF libre)

Toute famille orthogonale de vecteurs non nuls est libre.

Proof. Si \(\sum \lambda_i e_i = 0\), alors \(0 = \langle \sum_i \lambda_i e_i, e_j\rangle = \lambda_j \|e_j\|^2\), donc \(\lambda_j = 0\).

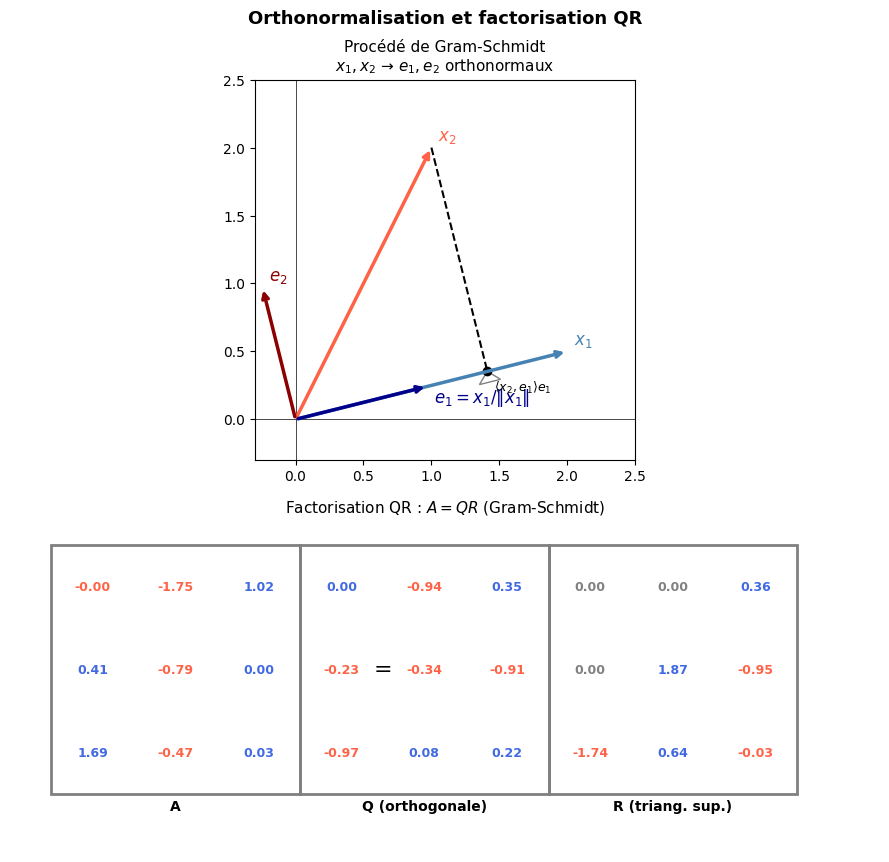

Procédé de Gram-Schmidt#

Théorème 5 (Gram-Schmidt)

Soit \((x_1, \ldots, x_k)\) une famille libre. Il existe une unique ONF \((e_1, \ldots, e_k)\) telle que \(\operatorname{Vect}(e_1, \ldots, e_j) = \operatorname{Vect}(x_1, \ldots, x_j)\) et \(\langle x_j, e_j\rangle > 0\) pour tout \(j\).

Proof. Algorithme. \(e_1 = x_1/\|x_1\|\). Pour \(j \geq 2\) :

\(\tilde{e}_j \neq 0\) car \(x_j \notin \operatorname{Vect}(x_1, \ldots, x_{j-1}) = \operatorname{Vect}(e_1, \ldots, e_{j-1})\). \(\langle \tilde{e}_j, e_i\rangle = \langle x_j, e_i\rangle - \langle x_j, e_i\rangle = 0\) pour \(i < j\).

Unicité : \(e_1\) est l’unique vecteur unitaire de \(\operatorname{Vect}(x_1)\) avec \(\langle x_1, e_1\rangle > 0\). Par récurrence.

Remarque 105

Corollaire : Tout espace euclidien admet une base orthonormale (BON).

Application : Factorisation QR d’une matrice \(A = QR\) avec \(Q\) orthogonale et \(R\) triangulaire supérieure, fondement de nombreux algorithmes numériques.

Projection orthogonale#

Théorème 6 (Projection orthogonale)

Soit \(E\) euclidien et \(F\) un sous-espace vectoriel. Alors \(E = F \oplus F^\perp\). Pour tout \(x \in E\), il existe un unique \(p_F(x) \in F\) tel que \(x - p_F(x) \in F^\perp\), donné par

où \((e_1, \ldots, e_k)\) est une BON de \(F\). De plus, \(p_F(x)\) est le point de \(F\) le plus proche de \(x\) :

Proof. Le produit scalaire restreint à \(F\) est défini positif, donc non dégénéré : \(F \cap F^\perp = \{0\}\) et \(\dim F + \dim F^\perp = n\) (chapitre précédent). Donc \(E = F \oplus F^\perp\).

\(p_F(x) = \sum \langle x, e_i\rangle e_i \in F\) et \(\langle x - p_F(x), e_j\rangle = \langle x, e_j\rangle - \langle x, e_j\rangle = 0\), donc \(x - p_F(x) \in F^\perp\).

Distance minimale : \(\|x-y\|^2 = \|x-p_F(x)\|^2 + \|p_F(x)-y\|^2 \geq \|x-p_F(x)\|^2\) (Pythagore, car \(x-p_F(x) \perp p_F(x)-y\)).

Proposition 281 (Inégalité de Bessel)

Soit \((e_1, \ldots, e_k)\) une ONF (pas nécessairement une base). Pour tout \(x \in E\) :

avec égalité si et seulement si \(x \in \operatorname{Vect}(e_1, \ldots, e_k)\).

Proof. \(\|x\|^2 = \|p_F(x)\|^2 + \|x - p_F(x)\|^2 = \sum_i \langle x, e_i\rangle^2 + \|x - p_F(x)\|^2\).

Remarque 106

Application — Moindres carrés : Étant donné \(b \in \mathbb{R}^m\) et \(A \in \mathcal{M}_{m,n}(\mathbb{R})\), la solution de moindres carrés minimise \(\|Ax - b\|^2\). C’est \(x^* = (A^TA)^{-1}A^Tb\) si \(A\) est de rang plein, car \(Ax^* = p_{\operatorname{Im}A}(b)\).

Matrices orthogonales#

Définition 196 (Groupe orthogonal)

\(M \in \mathcal{M}_n(\mathbb{R})\) est orthogonale si \(M^T M = I_n\) (équivalent : \(M^T = M^{-1}\), ou colonnes ONF, ou \(\|Mx\| = \|x\|\) pour tout \(x\)).

\(O_n(\mathbb{R}) = \{M : M^TM = I_n\}\) (groupe orthogonal), \(SO_n(\mathbb{R}) = \{M \in O_n : \det M = 1\}\) (groupe spécial orthogonal).

Proof. \(\det M = \pm 1\) \(1 = \det(I) = \det(M^TM) = \det(M)^2\).

Exemple 99

\(SO_2(\mathbb{R})\) : rotations \(R_\theta = \begin{pmatrix}\cos\theta & -\sin\theta \\ \sin\theta & \cos\theta\end{pmatrix}\).

\(O_2 \setminus SO_2\) : réflexions \(S_\theta = \begin{pmatrix}\cos\theta & \sin\theta \\ \sin\theta & -\cos\theta\end{pmatrix}\).

\(SO_3(\mathbb{R})\) : rotations de l’espace (3 paramètres, angles d’Euler).

Adjoint et endomorphismes symétriques#

Définition 197 (Adjoint)

Soit \(E\) euclidien et \(u \in \mathcal{L}(E)\). L”adjoint \(u^*\) est l’unique endomorphisme vérifiant

Dans une BON, \(\operatorname{Mat}(u^*) = \operatorname{Mat}(u)^T\).

Proof. Existence : pour tout \(y\), \(x \mapsto \langle u(x), y\rangle\) est linéaire. Par représentation de Riesz (en dimension finie : l’application \(x \mapsto \langle x, z\rangle\) est bijective de \(E\) sur \(E^*\)), il existe un unique \(u^*(y)\) tel que \(\langle u(x), y\rangle = \langle x, u^*(y)\rangle\). La linéarité de \(y \mapsto u^*(y)\) est immédiate.

Définition 198 (Types d’endomorphismes)

Symétrique (autoadjoint) : \(u^* = u\) (matrice symétrique dans une BON)

Antisymétrique : \(u^* = -u\) (matrice antisymétrique)

Orthogonal : \(u^* u = \operatorname{Id}\) (matrice orthogonale dans une BON)

Normal (cas complexe) : \(u^* u = u u^*\)

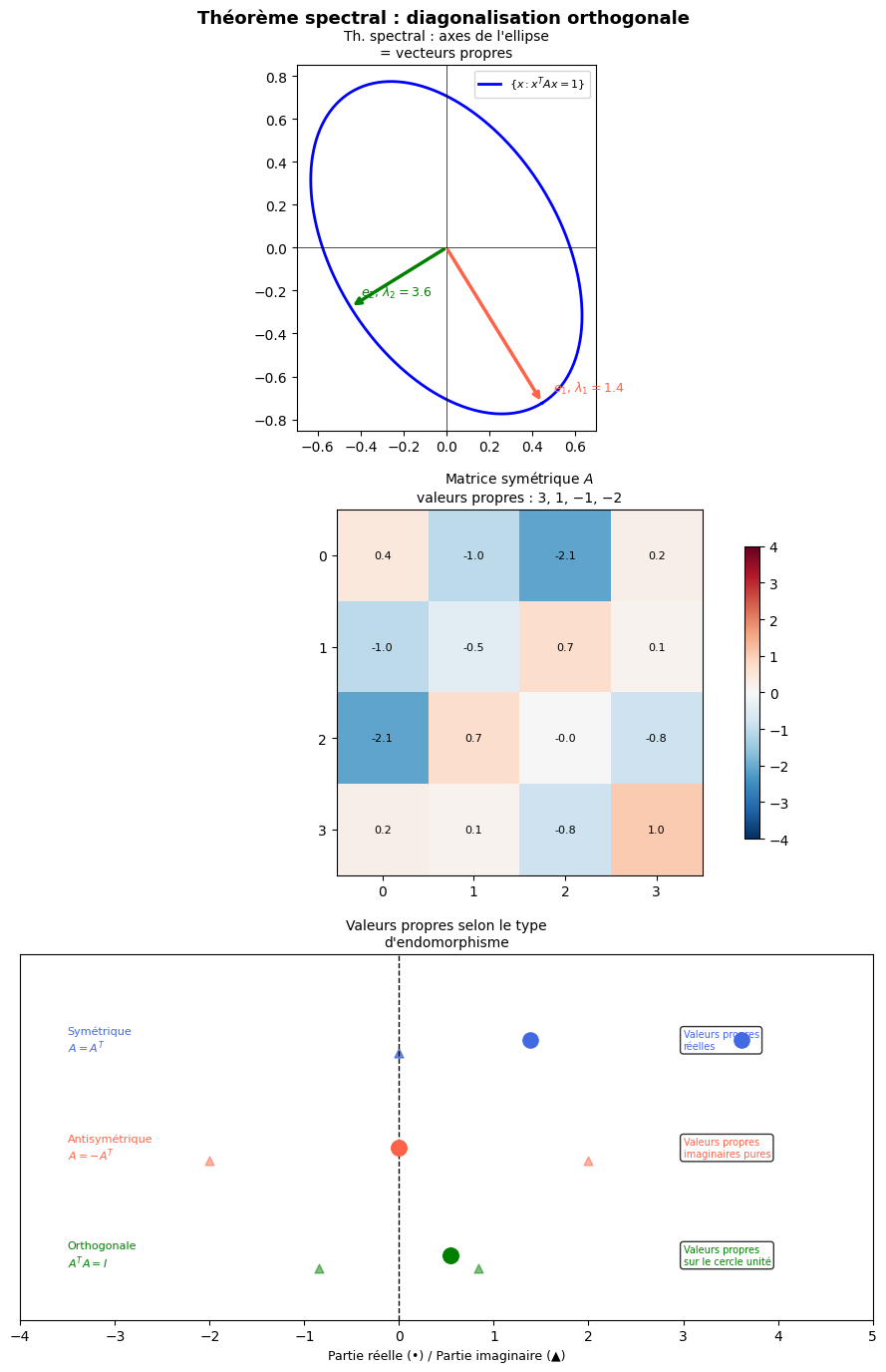

Théorème spectral#

Théorème 7 (Théorème spectral (cas réel))

Soit \(u\) un endomorphisme symétrique d’un espace euclidien \(E\). Alors :

Toutes les valeurs propres de \(u\) sont réelles

Les sous-espaces propres sont orthogonaux deux à deux

Il existe une BON de vecteurs propres de \(u\)

Autrement dit : toute matrice symétrique réelle \(A\) est orthogonalement diagonalisable : \(\exists P \in O_n(\mathbb{R})\) telle que \(P^T A P = D\) diagonale.

Proof. 1. Valeurs propres réelles. Soit \(\lambda\) valeur propre (complexe a priori) et \(v \neq 0\) vecteur propre, avec produit hermitien \(\langle \cdot, \cdot\rangle_{\mathbb{C}}\) sur \(\mathbb{C}^n\). \(\lambda \langle v, v\rangle_\mathbb{C} = \langle \lambda v, v\rangle_\mathbb{C} = \langle Av, v\rangle_\mathbb{C} = \langle v, A^Tv\rangle_\mathbb{C} = \langle v, Av\rangle_\mathbb{C} = \bar\lambda \langle v,v\rangle_\mathbb{C}\). Comme \(\langle v,v\rangle_\mathbb{C} > 0\) : \(\lambda = \bar\lambda \in \mathbb{R}\).

2. Sous-espaces propres orthogonaux. Si \(u(x) = \lambda x\), \(u(y) = \mu y\) avec \(\lambda \neq \mu\) : \(\lambda\langle x,y\rangle = \langle u(x),y\rangle = \langle x, u(y)\rangle = \mu\langle x,y\rangle\) Donc \((\lambda - \mu)\langle x,y\rangle = 0\), d’où \(\langle x,y\rangle = 0\).

3. BON de vecteurs propres. Par récurrence sur \(n\). Le polynôme caractéristique a ses racines réelles (par 1), donc \(u\) admet une valeur propre \(\lambda\) et un vecteur propre unitaire \(e_1\). L’orthogonal \(F = \{e_1\}^\perp\) est stable par \(u\) (car \(u\) symétrique : \(\langle u(x), e_1\rangle = \langle x, u(e_1)\rangle = \lambda\langle x, e_1\rangle = 0\)). On applique l’hypothèse de récurrence à \(u|_F\).

Remarque 107

Généralisation (cas complexe) : Tout endomorphisme normal (\(u^*u = uu^*\)) d’un espace hermitien est unitairement diagonalisable. En particulier :

Autoadjoint (\(u^* = u\)) : valeurs propres réelles

Unitaire (\(u^*u = I\)) : valeurs propres de module 1

Normal : diagonalisable en BON (et toute diagonalisable dans une BON est normale)

Résumé#

Concept |

Résultat clé |

|---|---|

Produit scalaire |

Forme bilinéaire symétrique définie positive |

Cauchy-Schwarz |

\(|\langle x,y\rangle| \leq |x|\cdot|y|\), égalité ssi colinéaires |

Gram-Schmidt |

Famille libre → BON, même espace engendré |

Projection |

\(p_F(x) = \sum\langle x,e_i\rangle e_i\), minimise \(d(x,F)\) |

Bessel |

\(\sum\langle x,e_i\rangle^2 \leq |x|^2\) |

Adjoint |

\(\langle u(x),y\rangle = \langle x, u^*(y)\rangle\) ; matrice : transposée (BON) |

Théorème spectral |

\(u\) symétrique \(\Rightarrow\) BON de vecteurs propres, valeurs propres réelles |

Groupe \(O_n\) |

Matrices orthogonales, \(\det = \pm 1\), \(SO_n\) = rotations |