Variables aléatoires continues#

Dieu ne joue pas aux dés… mais il en lance quand même à chaque instant.

Albert Einstein (paraphrase)

Introduction#

Le chapitre précédent étudiait les variables aléatoires prenant un nombre fini ou dénombrable de valeurs. De nombreux phénomènes — durée de vie, mesure physique, position d’une particule — prennent des valeurs dans un continuum. Ce chapitre développe la théorie des variables aléatoires continues, caractérisées par une densité de probabilité.

Variables aléatoires à densité#

Définition 283 (Fonction de répartition)

La fonction de répartition d’une variable aléatoire réelle \(X\) est

Proposition 338 (Propriétés de la fonction de répartition)

\(F\) est croissante

\(F\) est continue à droite : \(F(x^+) = F(x)\)

\(\lim_{x \to -\infty} F(x) = 0\) et \(\lim_{x \to +\infty} F(x) = 1\)

\(\mathbb{P}(a < X \leq b) = F(b) - F(a)\)

Les sauts de \(F\) en \(x\) valent \(\mathbb{P}(X = x)\)

Définition 284 (Variable aléatoire à densité)

\(X\) est une variable aléatoire à densité s’il existe \(f_X : \mathbb{R} \to \mathbb{R}_+\) intégrable telle que

La fonction \(f_X\) est la densité de \(X\).

Proposition 339 (Propriétés de la densité)

\(f_X \geq 0\) et \(\int_{-\infty}^{+\infty} f_X(t) \, dt = 1\)

\(F_X\) est continue (donc \(\mathbb{P}(X = x) = 0\) pour tout \(x\))

\(F_X\) est dérivable p.p. et \(F_X' = f_X\)

\(\mathbb{P}(a \leq X \leq b) = \mathbb{P}(a < X < b) = \int_a^b f_X(t) \, dt\)

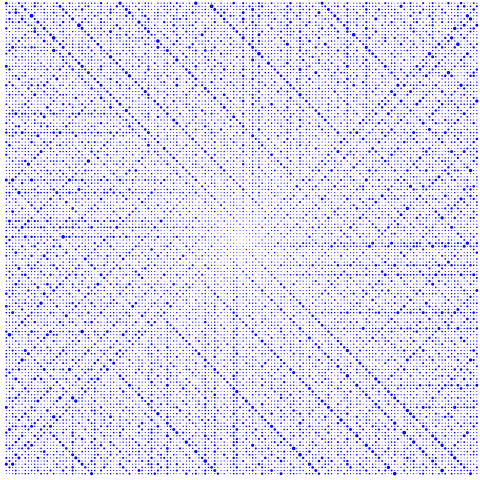

Lois continues classiques#

Définition 285 (Loi uniforme \(\mathcal{U}([a,b])\))

\(\mathbb{E}[X] = (a+b)/2\), \(\text{Var}(X) = (b-a)^2/12\).

Définition 286 (Loi exponentielle \(\mathcal{E}(\lambda)\))

\(\mathbb{E}[X] = 1/\lambda\), \(\text{Var}(X) = 1/\lambda^2\).

Modélise les durées de vie, les temps d’attente (processus de Poisson).

Proposition 340 (Absence de mémoire de l’exponentielle)

La loi exponentielle est l’unique loi continue vérifiant :

Proof. \(\mathbb{P}(X > t) = e^{-\lambda t}\). Donc \(\mathbb{P}(X > s+t \mid X > s) = e^{-\lambda(s+t)}/e^{-\lambda s} = e^{-\lambda t} = \mathbb{P}(X > t)\).

Unicité : Si \(g(t) = \mathbb{P}(X > t)\) est continue et vérifie \(g(s+t) = g(s)g(t)\) avec \(g(0) = 1\), \(g\) décroissante, alors \(g(t) = e^{-\lambda t}\) pour un \(\lambda \geq 0\) (les seules solutions continues de l’équation de Cauchy multiplicative).

Définition 287 (Loi normale \(\mathcal{N}(\mu, \sigma^2)\))

\(\mu \in \mathbb{R}\) est la moyenne, \(\sigma > 0\) l’écart-type. La loi normale centrée réduite est \(\mathcal{N}(0,1)\) : \(f(x) = \frac{1}{\sqrt{2\pi}}e^{-x^2/2}\).

Proposition 341 (Intégrabilité)

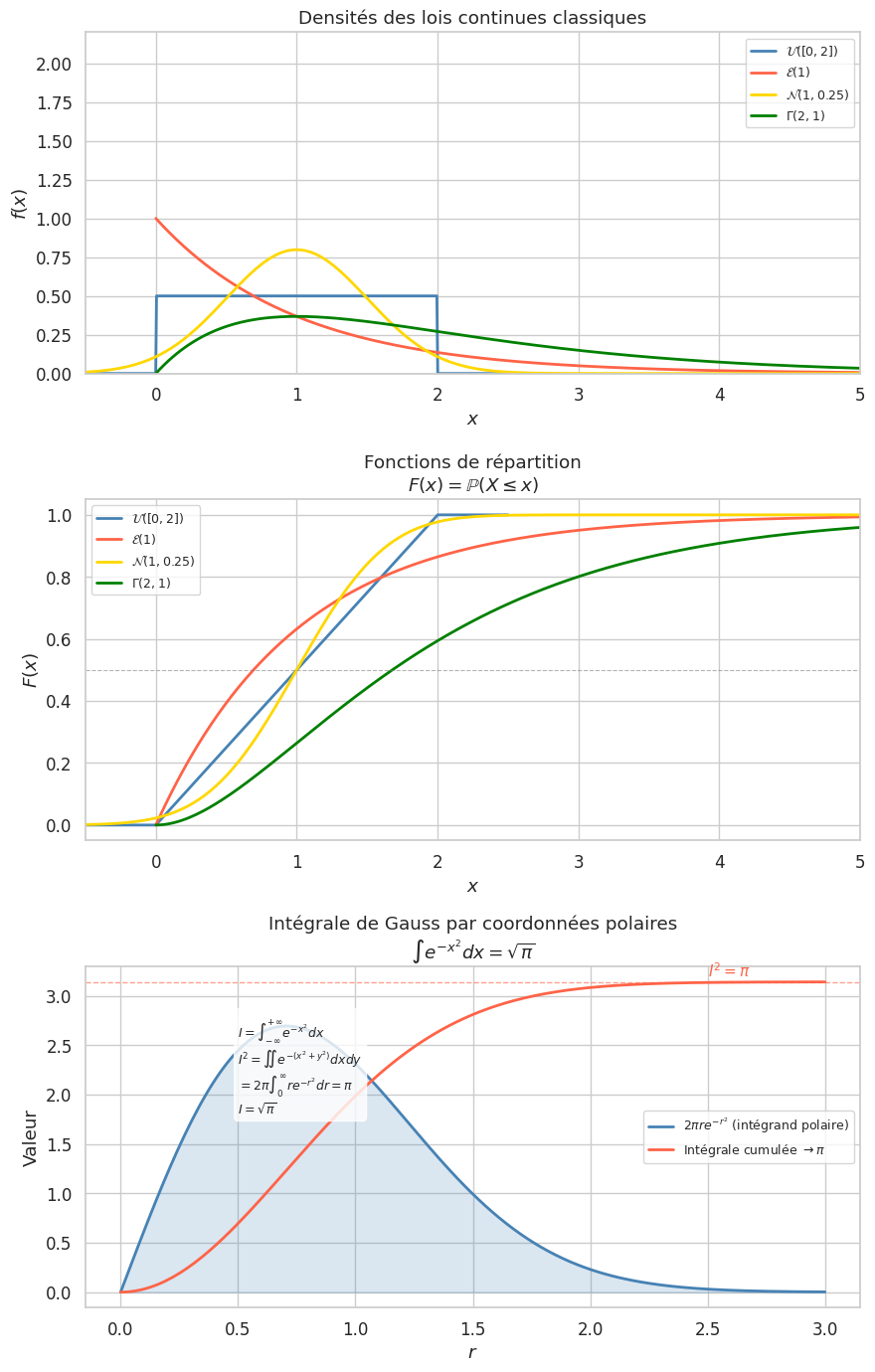

\(\int_{-\infty}^{+\infty} \frac{1}{\sqrt{2\pi}} e^{-x^2/2} dx = 1\).

Proof. Par le changement de variables \(x = t/\sqrt{2}\) dans l’intégrale de Gauss : \(\int_{-\infty}^{+\infty} e^{-x^2} dx = \sqrt{\pi}\) (calculée au chapitre 31 par coordonnées polaires). Donc \(\int e^{-t^2/2} dt/\sqrt{2} = \sqrt{\pi}\), soit \(\int e^{-t^2/2} dt = \sqrt{2\pi}\).

Définition 288 (Loi gamma \(\Gamma(\alpha, \lambda)\))

où \(\Gamma(\alpha) = \int_0^{+\infty} t^{\alpha-1} e^{-t} dt\) est la fonction gamma (\(\Gamma(n) = (n-1)!\)).

\(\Gamma(1, \lambda) = \mathcal{E}(\lambda)\)

\(\Gamma(n/2, 1/2) = \chi^2(n)\) (loi du chi-deux à \(n\) degrés de liberté)

Stable par somme : si \(X \sim \Gamma(\alpha, \lambda)\), \(Y \sim \Gamma(\beta, \lambda)\) indépendantes, alors \(X+Y \sim \Gamma(\alpha+\beta, \lambda)\)

Proposition 342 (Espérance et variance des lois classiques)

Loi |

\(\mathbb{E}[X]\) |

\(\text{Var}(X)\) |

|---|---|---|

\(\mathcal{U}([a,b])\) |

\((a+b)/2\) |

\((b-a)^2/12\) |

\(\mathcal{E}(\lambda)\) |

\(1/\lambda\) |

\(1/\lambda^2\) |

\(\mathcal{N}(\mu, \sigma^2)\) |

\(\mu\) |

\(\sigma^2\) |

\(\Gamma(\alpha, \lambda)\) |

\(\alpha/\lambda\) |

\(\alpha/\lambda^2\) |

Proof. Exponentielle : \(\mathbb{E}[X] = \int_0^\infty x\lambda e^{-\lambda x}dx\). Par IPP : \(= [-xe^{-\lambda x}]_0^\infty + \int_0^\infty e^{-\lambda x}dx = 1/\lambda\). \(\mathbb{E}[X^2] = 2/\lambda^2\) (double IPP). \(\text{Var}(X) = 2/\lambda^2 - 1/\lambda^2 = 1/\lambda^2\).

Normale centrée réduite : \(\mathbb{E}[X] = 0\) (intégrande impaire). \(\mathbb{E}[X^2] = \frac{1}{\sqrt{2\pi}}\int x^2 e^{-x^2/2}dx\). Par IPP (\(u = x\), \(dv = xe^{-x^2/2}dx\)) : \(\int x^2 e^{-x^2/2}dx = [-xe^{-x^2/2}]_{-\infty}^{+\infty} + \int e^{-x^2/2}dx = \sqrt{2\pi}\). Donc \(\mathbb{E}[X^2] = 1\).

Densité d’une fonction de variable aléatoire#

Théorème 77 (Changement de variable)

Si \(X\) a pour densité \(f_X\) et \(g : \mathbb{R} \to \mathbb{R}\) est un difféomorphisme de classe \(\mathcal{C}^1\), alors \(Y = g(X)\) a pour densité

Proof. Pour \(g\) strictement croissante : \(F_Y(y) = \mathbb{P}(g(X) \leq y) = \mathbb{P}(X \leq g^{-1}(y)) = F_X(g^{-1}(y))\). En dérivant : \(f_Y(y) = f_X(g^{-1}(y)) \cdot (g^{-1})'(y)\). Pour \(g\) strictement décroissante, on obtient un signe \(-\), d’où la valeur absolue.

Exemple 154

Si \(X \sim \mathcal{N}(0,1)\), alors \(Y = \mu + \sigma X \sim \mathcal{N}(\mu, \sigma^2)\). \(g^{-1}(y) = (y-\mu)/\sigma\), \((g^{-1})'(y) = 1/\sigma\). \(f_Y(y) = \frac{1}{\sqrt{2\pi}}e^{-(y-\mu)^2/(2\sigma^2)} \cdot \frac{1}{\sigma}\). ✓

Vecteurs aléatoires continus#

Définition 289 (Densité conjointe)

\((X, Y)\) est un vecteur aléatoire continu s’il admet une densité conjointe \(f_{X,Y} : \mathbb{R}^2 \to \mathbb{R}_+\) telle que

Définition 290 (Densités marginales et indépendance)

\(X\) et \(Y\) sont indépendantes \(\iff\) \(f_{X,Y}(x,y) = f_X(x) \cdot f_Y(y)\) pour tout \((x,y)\).

Somme de variables indépendantes : convolution#

Théorème 78 (Densité d’une somme)

Si \(X, Y\) sont indépendantes de densités \(f_X, f_Y\), alors \(Z = X + Y\) a pour densité

Proof. \(F_Z(z) = \mathbb{P}(X+Y \leq z) = \iint_{x+y \leq z} f_X(x)f_Y(y) \, dx \, dy = \int f_X(x)\left(\int_{-\infty}^{z-x} f_Y(y)dy\right) dx\). En dérivant par rapport à \(z\) (dérivation sous le signe intégral) : \(f_Z(z) = \int f_X(x) f_Y(z-x) dx\).

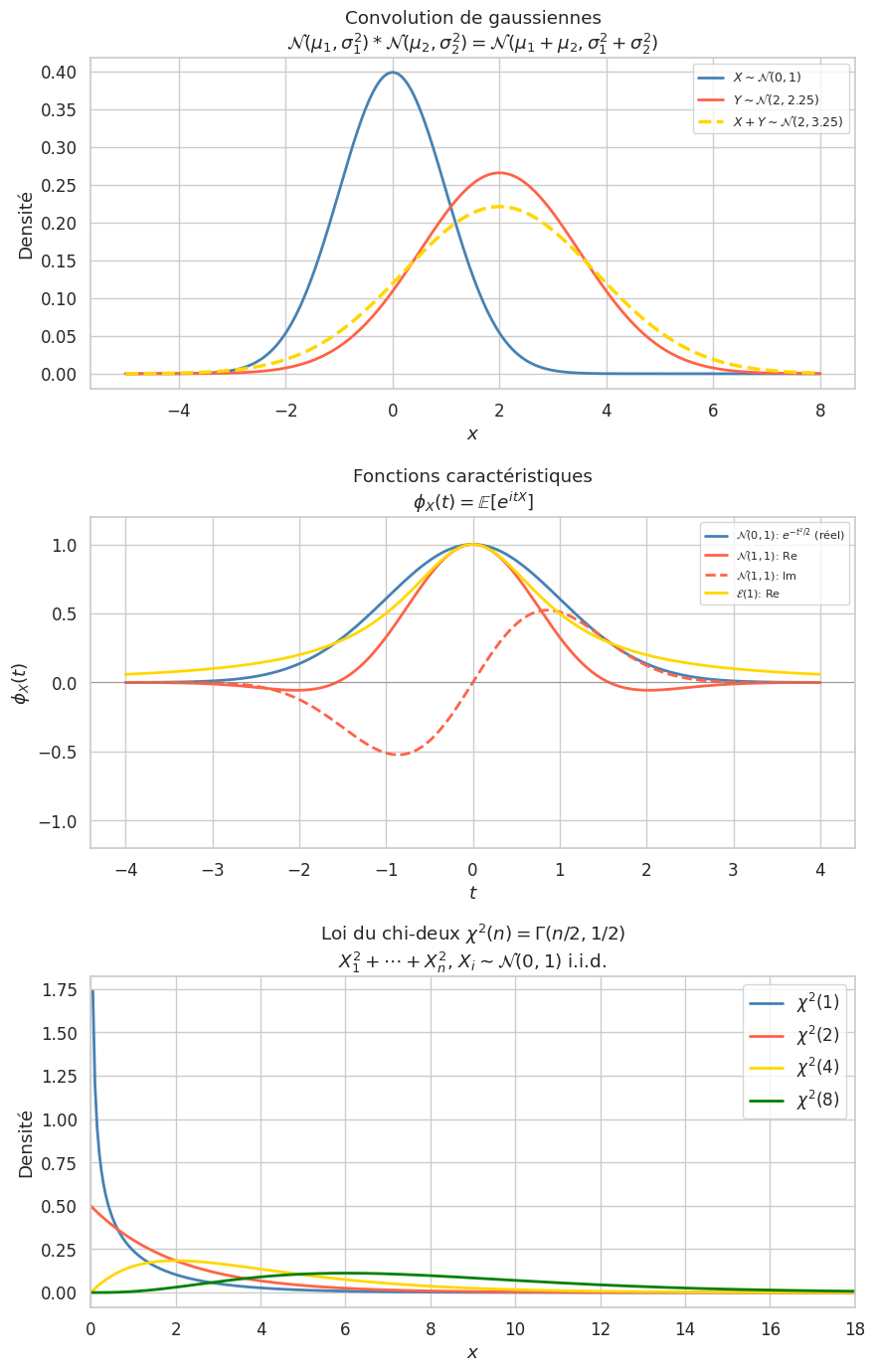

Exemple 155

\(X \sim \mathcal{N}(\mu_1, \sigma_1^2)\), \(Y \sim \mathcal{N}(\mu_2, \sigma_2^2)\) indépendantes \(\implies X+Y \sim \mathcal{N}(\mu_1+\mu_2, \sigma_1^2+\sigma_2^2)\)

Preuve : Par les fonctions caractéristiques : \(\phi_{X+Y}(t) = e^{i\mu_1 t - \sigma_1^2 t^2/2} \cdot e^{i\mu_2 t - \sigma_2^2 t^2/2} = e^{i(\mu_1+\mu_2)t - (\sigma_1^2+\sigma_2^2)t^2/2}\).

\(X \sim \mathcal{E}(\lambda)\), \(Y \sim \mathcal{E}(\lambda)\) indépendantes \(\implies X+Y \sim \Gamma(2,\lambda)\)

Fonction caractéristique#

Définition 291 (Fonction caractéristique)

La fonction caractéristique de \(X\) est

C’est la transformée de Fourier de la densité.

Proposition 343 (Propriétés)

\(\phi_X(0) = 1\) et \(|\phi_X(t)| \leq 1\)

\(\phi_X\) détermine uniquement la loi de \(X\) (injectivité de la transformée de Fourier)

\(X, Y\) indépendantes \(\implies \phi_{X+Y}(t) = \phi_X(t) \cdot \phi_Y(t)\)

\(\mathbb{E}[X^k] = \frac{\phi_X^{(k)}(0)}{i^k}\) (si le moment d’ordre \(k\) existe)

Continuité : \(X_n \xrightarrow{\mathcal{L}} X \iff \phi_{X_n}(t) \to \phi_X(t)\) pour tout \(t\) (théorème de Lévy)

Exemple 156

\(\mathcal{N}(0,1)\) : \(\phi(t) = e^{-t^2/2}\) (la gaussienne est sa propre transformée de Fourier à normalisation près)

\(\mathcal{N}(\mu,\sigma^2)\) : \(\phi(t) = e^{i\mu t - \sigma^2 t^2/2}\)

\(\mathcal{E}(\lambda)\) : \(\phi(t) = \frac{\lambda}{\lambda - it}\)

\(\mathcal{P}(\lambda)\) : \(\phi(t) = e^{\lambda(e^{it}-1)}\)

Proof. \(\mathcal{N}(0,1)\) : \(\phi(t) = \frac{1}{\sqrt{2\pi}}\int e^{itx}e^{-x^2/2}dx = \frac{1}{\sqrt{2\pi}}\int e^{-(x-it)^2/2}e^{-t^2/2}dx = e^{-t^2/2}\) (complétion du carré et intégrale de Gauss dans \(\mathbb{C}\)).

Résumé#

Concept |

Formule / Propriété |

|---|---|

Densité |

\(f \geq 0\), \(\int f = 1\), \(\mathbb{P}(a \leq X \leq b) = \int_a^b f\) |

Répartition |

\(F(x) = \mathbb{P}(X \leq x) = \int_{-\infty}^x f(t) dt\) |

Espérance |

\(\mathbb{E}[X] = \int xf(x)dx\) |

Transfert |

\(\mathbb{E}[g(X)] = \int g(x)f(x)dx\) |

Uniforme |

\(\mathbb{E}=(a+b)/2\), \(\text{Var}=(b-a)^2/12\) |

Exponentielle |

\(\mathbb{E}=1/\lambda\), \(\text{Var}=1/\lambda^2\), sans mémoire |

Normale |

\(\mathbb{E}=\mu\), \(\text{Var}=\sigma^2\), \(\phi(t)=e^{i\mu t-\sigma^2 t^2/2}\) |

Gamma |

\(\mathbb{E}=\alpha/\lambda\), \(\text{Var}=\alpha/\lambda^2\), stable par somme |

Convolution |

\(f_{X+Y} = f_X * f_Y\) (\(X,Y\) indépendantes) |

Fc. caract. |

\(\phi_{X+Y}=\phi_X\phi_Y\), détermine la loi, th. de Lévy |